Quanta energia consuma l’Ai? Un prompt di Gemini equivale a 9 secondi davanti alla Tv

Ci sono due domande a cui i chatbot non sanno mai rispondere con precisione e in modo univoco: «Chi te l’ha detto, sei sicuro?» e «Quanta energia consumi?». Sulle prime due ci stanno lavorando, ma sulla terza finalmente qualcosa di concreto lo sappiamo.

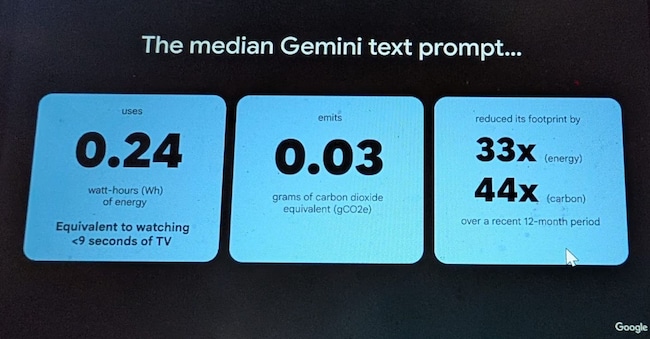

Una query testuale media di Gemini consuma 0,24 Wh e produce 0,03 grammi di CO₂. È paragonabile all’energia necessaria per guardare la TV per meno di 9 secondi. Queste stime – molto più basse rispetto ad altre ricerche di università e centri di ricerca – sono state presentate nel corso di un incontro riservato ai giornalisti per la presentazione di uno studio sull’impatto ambientale delle query AI, con focus sul modello Gemini.

È la prima volta che Google, dall’avvento dell’AI nel 2022, esce «allo scoperto» con dei numeri. Il motivo, è stato spiegato nel corso dell’evento, ed è anche quello di contribuire a far uscire allo scoperto anche gli altri AI provider come Microsoft, AWS e OpenAI, che finora non si sono mai espressi sui propri consumi di energia.

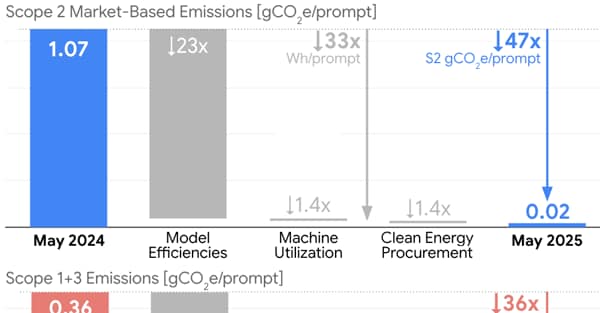

L’immagine evidenzia la riduzione delle emissioni per prompt del modello Gemini dal maggio 2024 al maggio 2025. Le emissioni Scope 2 sono state ridotte di 47 volte, passando da 1,07 gCO₂e/prompt a 0,02 gCO₂e/prompt, principalmente grazie a miglioramenti nell’efficienza del modello e nell’utilizzo delle macchine. Le emissioni Scope 1+3 sono diminuite di 36 volte, da 0,36 a 0,01 gCO₂e/prompt. In sintesi, il grafico dimostra come l’ottimizzazione del modello, una migliore gestione dell’hardware e l’approvvigionamento di energia pulita abbiano drasticamente ridotto l’impronta di carbonio per ogni prompt generato, con una riduzione particolarmente significativa delle emissioni Scope 2.

Come ha spiegato Partha Ranganathan, Engineering Fellow e vicepresidente a Google: «Sviluppare una metodologia completa e condividerne i risultati, con l’obiettivo finale di incoraggiare una coerenza a livello di settore nella misurazione dell’impatto ambientale e dell’efficienza relativa dell’inferenza AI». L’obiettivo sarebbe quindi quello di proporre uno standard condiviso con l’industria dell’AI.

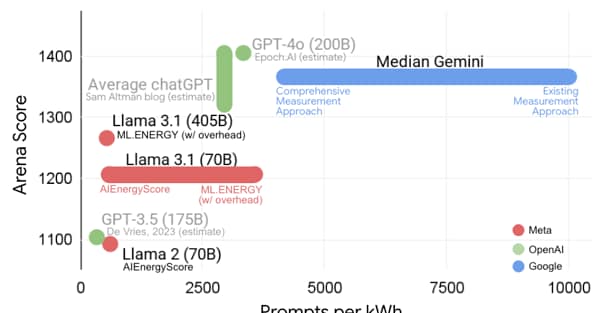

Il grafico confronta l’efficienza energetica e le prestazioni di vari modelli di linguaggio di grandi dimensioni (LLM), tra cui quelli di Meta (Llama), OpenAI (GPT) e Google (Gemini). I modelli di Google (Gemini) si posizionano come i più efficienti dal punto di vista energetico, con un alto numero di prompt per kWh e un elevato Arena Score. La barra blu etichettata “Median Gemini” indica un’ampia gamma di efficienze misurate con approcci diversi (“Comprehensive Measurement Approach” e “Existing Measurement Approach”).

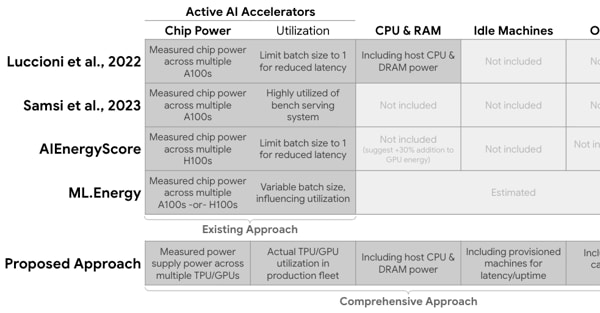

Molte delle attuali metodologie di calcolo nel settore trascurano diversi fattori critici e non tengono conto di ogni livello dello stack IA, dall’hardware sottostante e dai data center fino al modello stesso. Per ovviare a questo, Google ha sviluppato una metodologia completa che include consumo di macchine inattive, CPU, RAM, raffreddamento e distribuzione elettrica, non solo l’energia dei chip.

Come ha tenuto a precisare Partha Ranganathan, che si occupa principalmente delle infrastrutture di calcolo e dei data center dell’azienda, con particolare attenzione all’efficienza e alla sostenibilità, lo studio si concentra solo su domande testuali medie. L’analisi abbraccia un arco temporale di 12 mesi e quindi include una più ampia diversità di prompt. In particolare, è stato misurato il “prompt mediano” che viene definito come il prompt che si posiziona al 50° percentile in termini di consumo energetico. Il processo funziona così: per ogni modello di AI, si calcola l’energia media consumata per elaborare un singolo prompt (una singola richiesta dell’utente). Si crea una classifica: tutti i prompt inviati dagli utenti vengono messi in una lista e ordinati in base al consumo energetico necessario per elaborarli. A questo punto si identifica il 50° percentile cioè si individua il prompt che si trova esattamente a metà di questa classifica. Questo è il “prompt mediano”. Il limite di questo studio è che non ci dice nulla sui sistemi text-to-image e text-to-video, quelli, per intenderci, che generano immagini e video e proprio per questo considerati più energivori. I ricercatori a questo proposito hanno spiegato che c’è poco consenso su come misurare l’impatto di altri tipi di generazione. Inoltre, sarebbe scientificamente scorretto fornire stime per confrontare in termini di impatto energetico le domande al motore di ricerca di Google con una query a Gemini.

«I modelli di interazione sono diversi – ha affermato Ranganathan – sarebbe come confrontare mele con le pere».

Il grafico confronta diverse metodologie di misurazione del consumo energetico dei modelli di intelligenza artificiale, mettendo a confronto gli approcci esistenti con una metodologia proposta (Proposed Approach). La tabella scompone il consumo in diverse categorie: “Chip Power”, “Utilization”, “CPU & RAM”, “Idle Machines” e “Overhead”. Questo approccio, definito “Comprehensive Approach”, mira a una misurazione più completa e realistica del consumo energetico.

Una query media cioè un prompt mediano di Gemini utilizza 0,26 ml d’acqua (circa 5 gocce). Gli esperti di Google hanno tenuto a precisare che l’uso di acqua può ridurre del 10% i consumi energetici rispetto al raffreddamento ad aria. Nei siti in zone a stress idrico, come Mesa in Arizona, viene scelto il raffreddamento ad aria per non pesare sulle risorse locali. Oltre il 25% dei data center usa acqua non potabile o riciclata.

0,24 Wh per query potrebbe sembrare poco, ma questa cifra è solo per un prompt molto semplice, come «ciao»? Il consumo energetico aumenta man mano che una conversazione si sviluppa, le query diventano più complesse e la memoria richiesta cresce di conseguenza. Molti analisti sostengono che misurare l’impatto ambientale dell’IA generativa per singola query è una informazione fondamentale, ma non aiuta a stimare il reale impatto dell’AI inteso come volume di domande che gli utenti effettuano ogni giorno. Leggendo tra i dati della trimestrale di Google relativa al secondo trimestre del 2025 abbiamo contezza degli utenti ma non sui volumi di traffico. L’app Gemini ha più di 450 milioni di utenti attivi mensili mentre le richieste giornaliere che sono aumentate di oltre il 50% rispetto al primo trimestre. Quindi non sappiamo quanto consuma energia consuma l’uso di Gemini. Dobbiamo accontentarci di avere una unità di misura che ha però il merito se venisse adottata di aiutare a comparare gli LLM sul mercato.

La dimensione dei modelli di IA, come Gemini, è cresciuta esponenzialmente (raddoppiando ogni circa 3 mesi e mezzo). Google, hanno spiegato, sta innovando per migliorare l’efficienza energetica, implementando controlli intelligenti e riprogettando i sistemi di distribuzione dell’energia. Stanno anche spostando i carichi di lavoro di IA per usare l’elettricità durante i periodi di minor stress sulla rete.

In 12 mesi Google ha ridotto l’impronta per query di 33 volte in termini energetici e di 44 volte in termini di emissioni di CO₂.

Notizie e approfondimenti sugli avvenimenti politici, economici e finanziari.

Iscrivitiilsole24ore